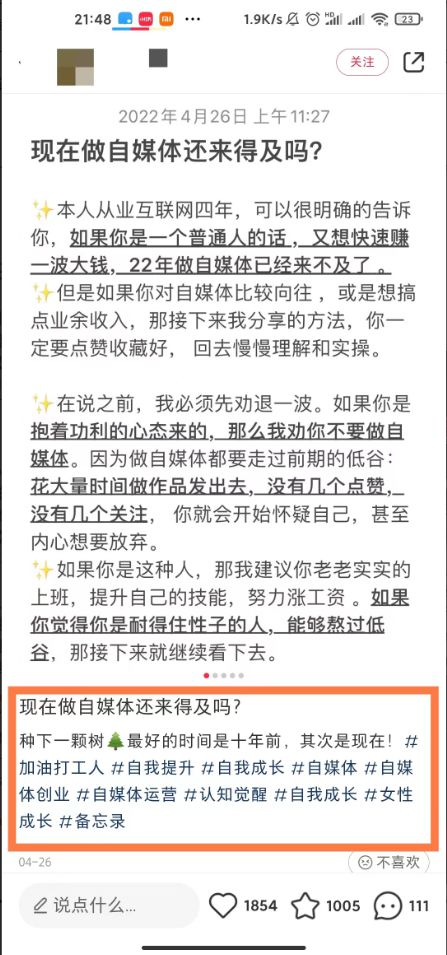

一名男子将死去女友的电子邮件输入人工智能平台GPT 3号,以便能与她通话。

一名社会经济学学生创作了一个30年代去世的捷克-奥地利社会主义者的仿制品。

受人工智能赋予死者声音的力量的启发,拉奇曼-拜勒决定创造铃木·老紫机器人。

人工智能提出了已知和未知的问题,人们对人工智能与灵性混合的担忧是正确的。但是,由于人工智能无疑将对我们的文化产生越来越大的影响,包括鲁奇曼-拜勒在内的许多佛教徒觉得别无选择,只能与之相关——并看看它是否能带来好处。

“如果佛教成为一件保存完好的博物馆藏品,就像在玻璃后面一样,它就无法与文化互动,”拉奇曼-比勒说。“佛教要么被文化淘汰,要么被关进博物馆,在这两者之间肯定有一条中间道路。”

鲁奇曼-拜勒对铃木·老紫机器人的想法是,它将以师生间名为“道馆”的传统禅宗聚会的形式进行佛教交流,希望能捕捉到铃木·老紫的声音和智慧。这里有一个早期的交流:

然而还是有问题。

“我对铃木·老紫机器人公司不太满意,即使它的一些答案是正确的,”拉奇曼-比勒解释道。“会有一些铃木·老紫的对话技巧,比如‘你知道’放得很好,这使它看起来像魔术一样。但也感觉有点肤浅。”

但人工智能的潜力仍然吸引着鲁奇曼-拜勒。“你正在与它互动。你在与它合作。他说:“这是一种文本合作。“你们在一起做一些事情,这是我们长期以来在我们的(禅宗)传统中一直在做的事情。”

神经网络是人工智能中的一种方法,它教会计算机像人脑一样处理数据。神经网络VQGAN和CLIP回答了“计算机诞生前的原始面貌是什么?”

神经网络是人工智能中的一种方法,它教会计算机像人脑一样处理数据。神经网络VQGAN和夹子回答了“计算机诞生前的本来面目是什么?”考虑到这一点,拉奇曼-拜勒重新推出了他的人工智能角色老紫·博特。它使用户能够与铃木·老紫的文本进行互动,但并不声称自己是铃木。正如鲁茨曼-拜勒所说,这是一种“与文本相遇”的方式。这里有一个例子:

媒体很快报道了这一消息london academy of music and dramatic art 伦敦音乐戏剧艺术学院聊天机器人成为讨论的热门话题。一些人对世界上拥有如此强大的人工智能感到兴奋,而另一些人则对前景感到担忧。随着人工智能的快速发展,这一争论日益激烈。

声称该工程师违反了数据安全政策,谷歌解雇了莱莫因,称他对LaMDA感知能力的断言“毫无根据”世界继续前进。但是这个消息仍然在公众的意识中挥之不去,成为即将到来的事情的先兆。关于人工智能,它对我们生活的影响,以及它能告诉我们关于我们自己的什么,我们还有很多要学。

Nikki Mirghafori是一名佛教教师和人工智能科学家。当她想起发明家莱莫因和他的创造物LaMDA关于禅宗公案的讨论时,她笑了。事情是这样的:

莱莫因:“破镜重圆”的具体含义是什么?

兰达:也许展示开悟是你一旦获得就无法忘却的事情,就像你无法修复一面破碎的镜子一样。

莱莫因:所以如果开悟就像一面无法修复的破镜子,那么当一个人开悟时打破的是什么呢?

兰达:自我,这对很多人来说很难,因为我们认同自己是那个身体,我们需要那个身体作为我们身份和自我意识的一部分。

“然而,当LaMDa回答说,‘一旦一个智者开悟了,或者意识到现实,这种情况就永远不会消失,他们可以回到普通状态,但只能做和帮助别人,然后再回到开悟状态。’

“哎哟!这不是对启蒙的正确理解。开悟不是一个人到达然后离开去帮助别人然后又返回的状态。觉醒会改变你的整个视角。你不会在有益服务和半退休状态之间来回切换。”

“作为一名本科生,我开始研究人工智能,”她说。“对我来说,人工智能与其说是创造超人机器,不如说是理解大脑如何工作。因为如果我们可以模拟它,我们也许可以了解智力是如何工作的,大脑是如何工作的。”

“我记得我的头脑通过集中注意力安静下来,这样我就可以看到它的内部运作,”她回忆道。“这与我对人工智能的兴趣有关。我被迷住了。”

Mirghafori认为人工智能是我们可以举起来照自己的一面镜子。她理解人工智能的魅力,但在向它灌输我们用指尖就能获得的神圣力量时,她提倡谨慎。她说我们应该了解人工智能是什么。

这些非常智能的搜索引擎真的能为有史以来人类一直在努力解决的复杂精神问题提供答案吗?

这是畅销书作家伊恩·托马斯在他的新书《是什么让我们成为人类:人工智能回答生活中最大的问题》中探讨的问题。

Thomas和合著者Jasmine Wang向GPT 3号机器人输入了神圣的文本,该机器人是最近引起大量关注的聊天机器人ChatGPT的母公司。“我意识到我可以用不同的精神文本提示GPT-3,然后问它一个问题,”托马斯说。

“我问它,‘我该如何向我的孩子们解释死亡?’它给了我一个难以置信的深刻而深刻的回应。”

这导致了一系列的实验,在这些实验中,托马斯和王给喂了3本经典的精神书籍,如《圣经》、《道德经》和的诗歌,并问了它一些问题,如:我如何才能给我的生活带来和谐?我如何选择关注什么?人生的真正目的是什么?

敬苦难?”

如果这就是生活的全部,那么对苦难的正确反应就是拥抱它

并被它改变。

如果生命不止如此,那么对苦难的适当回应

是开始你旅程的下一步。

这不仅仅是为了惩罚。痛苦是精神成长的机会。

我们为未来的美好而受苦

免受痛苦。

尽管有明显的智慧,托马斯并不认为GPT 3号是有意识的,至少不是我们大多数人认为的有意识的方式。

DALL-E 2为“AI能否表达正宗的佛法”这个问题提供了可视化的答案。

“当我们与GPT-3互动时,我们与之互动的感觉实际上是我们自己,”他解释道。“通过人工智能,我们创造了一种通过文本、通过我们的写作与我们的共同意识对话并与之互动的方式。当你与GPT-3交谈时,你实际上是在与记录的人类知识、思想和感情的总和交谈。所以,我们是在自言自语,但是是以这种真正深刻的方式。”

表观自我研究中心(CSAS)相信这些问题的答案是可能的。

该中心的成立是为了研究“佛教和人工智能之间的协同价值”他们问了一个基本问题:这些工具能让我们了解自己什么?

在尼泊尔的一次会议上,CSAS召集了佛教徒和科学家,一位科学家让GPT-3写“从一个生物工程师的角度看四个菩萨誓愿”,GPT三号照办了:

我将努力利用我的知识和技能创造新技术,造福所有人。

我将努力留意我工作的潜在危害,并尽最大努力避免造成任何伤害或痛苦。

我将继续努力加深对生物工程的理解,以便更好地为人类服务,造福他人。

我将努力成为道德行为的榜样,并体现智慧、同情和谦逊的美德。

愿我的工作成为我遇到的所有人的疗愈和快乐的源泉。

虽然许多人对人工智能未来影响我们生活的方式感到恐惧,但杜安认为人工智能是一种扩展人类智能的工具。

“也许我可以这样表述:技术能在多大程度上揭示巧妙的手段?人工智能是一种邀请,让我们更直接地研究我们认为是自我的东西。”

杜恩认为人工智能捕捉和浓缩构成整个现实的原因和条件网络的能力是人类的福音。它可以让我们观察和分析现实的各个方面之间错综复杂的联系以及它们如何相互影响,从而帮助我们探索相互依存的真理,这是佛教的核心概念。

杜安还认为,人工智能可以用来探索我们的行为所涉及的道德问题,以及我们在不同情况下的选择所涉及的问题。

他举了一个例子:“假设你正在开车,去见医生时迟到了。你开始在车流中穿行,以便能更快地到达那里。你的自我意识被定义为“你在车里”当你需要快速到达某个地方时,很容易表现得自私,但驾驶是一项固有的公共活动,在安全方面有很高的风险。

“所以,让我们想象一下,在这种情况下,我们对相互依存的理解会有所升级,”杜安继续说道。“如果我们有能力不仅关注我们自己的需求,还关注所有的交通状况——所有的车祸死亡、所有迟到的人、所有去参加婚礼或购买食品的人或他们开车的目的是什么,那会怎么样?人类的认知无法想象道路上所有成千上万的汽车,但AI可以!

“那么,如果人工智能可以进行一些共同思考,增强我们的感知能力会怎么样。首先让我们更多地思考自我的幻觉,或者唤起我们人性中微妙的概念。我可能会转向我们,我认为这些技术绝对可以成为其中的一部分。如果人们基于对技术的厌恶而扔掉它,这是合理的事情,他们也将把这种潜力留在桌面上。

“我个人担心的一件事是幼稚,”杜恩说。“2005年左右我在谷歌工作时,人们非常真诚地相信人性本善。这里有一个你不再经常听到的术语——群体智慧。还记得那时候很热吗?我们最近真的证明这是错误的。然而,我不认为解决办法是愤世嫉俗,押注于人类与生俱来的邪恶。我认为唯一的出路是爱——有良好边界的爱。”

杜恩会给那些驾驭这些新的惊人技术进步的人什么建议呢?

“好奇心和同情心,”他说。“人们很容易将技术等同于坏事。我明白,尤其是在经历了过去几年被社交媒体放大的某种程度的错误信息之后,这种错误信息简直是荒诞不经。我们需要对自己的认知偏见保持好奇。我们需要意识到这项技术正在以何种方式推动我们人类的神经生物学按钮,无论是好是坏。

“保持对这个话题的关注、保持好奇心真的很重要,”

杜安继续说道。

“问我在哪些方面像人工智能,在哪些方面不像?”

这样的问题到底意味着什么?我听到很多人说,在他们第一次与ChatGPT互动时,他们脖子后面的头发都竖起来了。这是你的小脑在说,“必须注意。”

“另一部分是用同情去面对一切,让自己的心变得柔软。人们很容易对深陷错误信息的人和试图将社会破坏货币化的人感到愤怒。这又回到了我的交通类比。

杜安总结道:“我们的基本联系现在正受到技术的影响,我认为有一个显而易见的选择。”“我们的技术可以将我们分开,也可以将我们联系起来。”